Google hat eine wichtige Änderung vorgenommen: Der Googlebot begrenzt beim Crawling von HTML-Dateien jetzt die maximale Größe, die er pro Seite abruft. Seiten, die größer als 2 MB sind, werden dadurch nicht mehr vollständig gecrawlt und indexiert.

Bei den meisten Websites liegt die HTML-Dateigröße zwar deutlich unter der neuen Grenze (wie unsere Daten zeigen), aber für betroffene Seiten kann das neue Limit ein ernstes Problem darstellen.

Gleichzeitig ist die Änderung ein klares Signal: Technische Effizienz wird für Google immer wichtiger. In Zeiten von KI-gestützter Suche und steigenden Rechenkosten muss auch Google Ressourcen gezielter einsetzen und erwartet dasselbe von Websites.

In diesem Artikel schauen wir uns an, was sich genau geändert hat, welche Auswirkungen das auf Deine Website haben kann und wie Du mit Seobility prüfst, ob Deine Seiten betroffen sind. Außerdem zeigen wir Dir, was Du konkret tun kannst, um die Dateigrößen Deiner Website zu reduzieren.

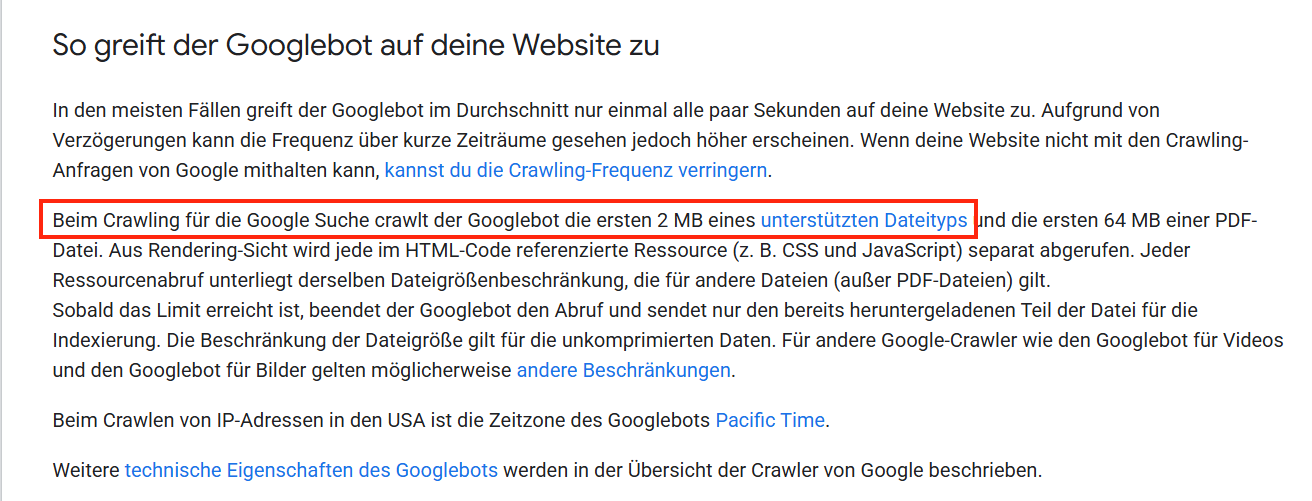

Was genau hat Google geändert?

Bis vor Kurzem hat Google beim Crawlen einer Seite bis zu 15 Megabyte des HTML-Codes abgerufen. Dieses Limit wurde nun deutlich gesenkt: Der Googlebot lädt jetzt maximal 2 Megabyte pro Datei.

Konkret bedeutet das: Ist eine HTML-Datei größer als 2 MB, ruft Google nur noch die ersten 2 MB der Seite ab. Alles, was danach kommt, wird nicht mehr berücksichtigt, also auch nicht indexiert.

Wichtig dabei: Diese Begrenzung gilt nicht nur für HTML-Seiten, sondern auch für andere textbasierte Dateien wie CSS und JavaScript. Jede dieser Dateien wird zwar separat geladen, unterliegt aber jeweils demselben 2-MB-Limit. Eine Ausnahme bilden nur PDFs, für die weiterhin ein deutlich höheres Limit von 64 MB gilt.

Die Änderung wurde von Google bislang nicht groß angekündigt, ist aber bereits in der Google-Dokumentation zum Crawling zu finden:

Warum macht Google das?

Eine offizielle Erklärung von Google zu dieser Änderung gibt es bislang nicht. Die Anpassung wurde in der Dokumentation still vorgenommen, ohne Ankündigung oder weiterführende Begründung.

Wahrscheinliche Gründe

Es ist davon auszugehen, dass Google mit dem niedrigeren Crawl-Limit vor allem Ressourcen sparen möchte. Das Crawlen, Rendern und Verarbeiten großer Dateien sind teuer, und dieser Aufwand steigt weiter, je mehr Inhalte im Web entstehen.

Hinzu kommt der zunehmende Fokus auf KI in der Suche. z.B. durch AI Overviews. Zur Generierung dieser Antworten müssen riesige Datenmengen effizient verarbeitet werden. Schlankere, klar strukturierte Seiten helfen Google dabei, Inhalte schneller und zuverlässiger zu erfassen.

SEO-Einordnung

Aus SEO-Sicht passt die Änderung gut zu den Entwicklungen der letzten Jahre, wie z.B. die Einführung der Core Web Vitals. Google bevorzugt Websites, die technisch sauber, effizient und nutzerfreundlich sind.

Aufgeblähter Code, unnötige Skripte und überladene Seiten bringen keinen Mehrwert und werden zunehmend weniger toleriert. Stattdessen rücken klare Inhalte und eine solide technische Basis weiter in den Fokus.

Welche Dateitypen sind betroffen?

Google wendet die neue Grenze auf alle textbasierten Dateien an, die beim Laden einer Seite abgerufen werden. Wichtig dabei: Jede Datei wird einzeln betrachtet, hat also ihr eigenes Limit.

HTML-Dateien (am kritischsten)

HTML-Dateien sind am stärksten betroffen. Sie enthalten den eigentlichen Seiteninhalt, also Texte, Überschriften, interne Links und strukturierte Daten.

Ist die HTML-Datei größer als 2 MB, kann es passieren, dass wichtige Inhalte am Ende der Seite von Google gar nicht mehr gesehen werden.

CSS-Dateien

Auch CSS-Dateien unterliegen dem neuen Limit. Große oder nicht optimierte Stylesheets können dazu führen, dass Google nur einen Teil davon abruft. Das betrifft zwar nicht direkt den Content, kann aber Einfluss darauf haben, wie Google Deine Seite rendert und versteht.

JavaScript-Dateien

JavaScript-Dateien werden ebenfalls nur bis maximal 2 MB gecrawlt. Besonders problematisch ist das bei Websites, die Inhalte stark über JavaScript nachladen. Wird eine JS-Datei nur teilweise abgerufen, kann das dazu führen, dass Inhalte für Google unvollständig oder gar nicht sichtbar sind.

(Allerdings solltest Du wichtige Inhalte ohnehin nicht über JavaScript laden, wie wir in unserem Artikel zu JavaScript-SEO erklären.)

Was bedeutet das konkret für Deine Website?

Alles, was im HTML-Code außerhalb des 2-MB-Limits liegt, wird von Google nicht mehr verarbeitet. Das kann dazu führen, dass:

- wichtige Texte nicht indexiert werden

- interne Links nicht erkannt werden

- strukturierte Daten fehlen

Mögliche SEO-Folgen

Wenn Google eine Seite nicht vollständig erfassen kann, hat das direkte Auswirkungen auf die Bewertung dieser Seite:

- Google versteht den Inhalt nicht vollständig

- Themen, Keywords oder Zusammenhänge werden falsch oder nur teilweise erkannt

- Rankings können sich verschlechtern, weil Google den Mehrwert der Seite nicht korrekt einschätzt

Wie viele Websites sind wirklich betroffen? Ergebnisse aus einer Seobility-Datenanalyse

Um besser einschätzen zu können, wie relevant das neue Crawl-Limit in der Praxis ist, haben wir uns die Daten aus Seobility genauer angesehen.

Dafür haben wir die HTML-Dateigrößen von rund 44,5 Millionen Seiten analysiert, die mit Seobility gecrawlt wurden. Das Ergebnis ist eindeutig:

Nur 0,82 % aller untersuchten Seiten sind größer als 2 MB.

Das bedeutet: Für die große Mehrheit der Websites stellt das neue Google-Limit aktuell kein akutes Problem dar. Ist eine Deiner Seiten jedoch betroffen, dann besteht Handlungsbedarf.

Hier die vollständige Verteilung der HTML-Dateigrößen:

- 83,76 % der Seiten sind größer als 50 KB

- 68,96 % größer als 100 KB

- 40,45 % größer als 250 KB

- 18,73 % größer als 500 KB

- 5,5 % größer als 1 MB

- nur 0,82 % größer als 2 MB

Auch große Websites sind betroffen

Trotz der eher niedrigen Fallzahlen ist es uns wichtig zu betonen, dass dieses Thema nicht nur kleine oder schlecht gepflegte Websites betrifft. Auch große, bekannte Plattformen mit professionellen SEO-Teams können an die neuen Grenzen stoßen.

In Stichproben finden sich zum Beispiel HTML-Seiten mit deutlich über 2 MB bei bekannten Websites wie OMR Reviews (ca. 3,4 MB) oder Zalando (ca. 2,6 MB).

Das ist kein Qualitätsurteil über diese Seiten. Im Gegenteil: Gerade komplexe Websites mit vielen Funktionen, Filtern, Tracking-Setups oder dynamischen Inhalten laufen schneller Gefahr, technisch sehr große HTML-Dateien zu erzeugen.

Die Beispiele zeigen also, dass das neue Crawl-Limit ein strukturelles Thema und kein Anfängerfehler ist.

So prüfst Du mit Seobility, ob Deine Seiten betroffen sind

Mit Seobility kannst Du schnell herausfinden, ob es auf Deiner Website Seiten gibt, deren Dateigröße problematisch werden könnte.

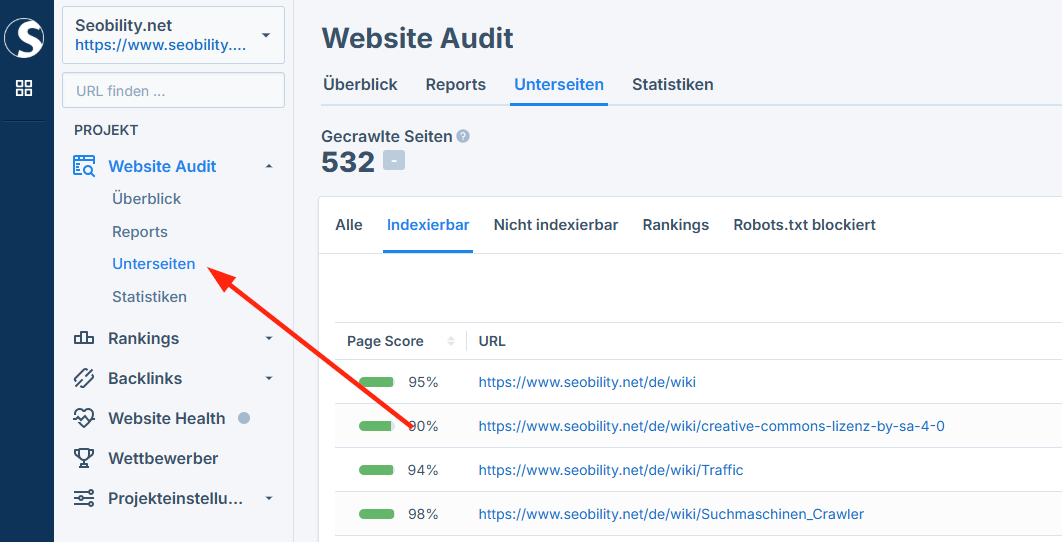

- Öffne den Tab “Unterseiten” im “Website Audit” Bereich Deines Seobility Projekts. (Wenn Du das Seobility Website Audit noch nicht nutzt, kannst Du es hier 14 Tage kostenlos testen.)

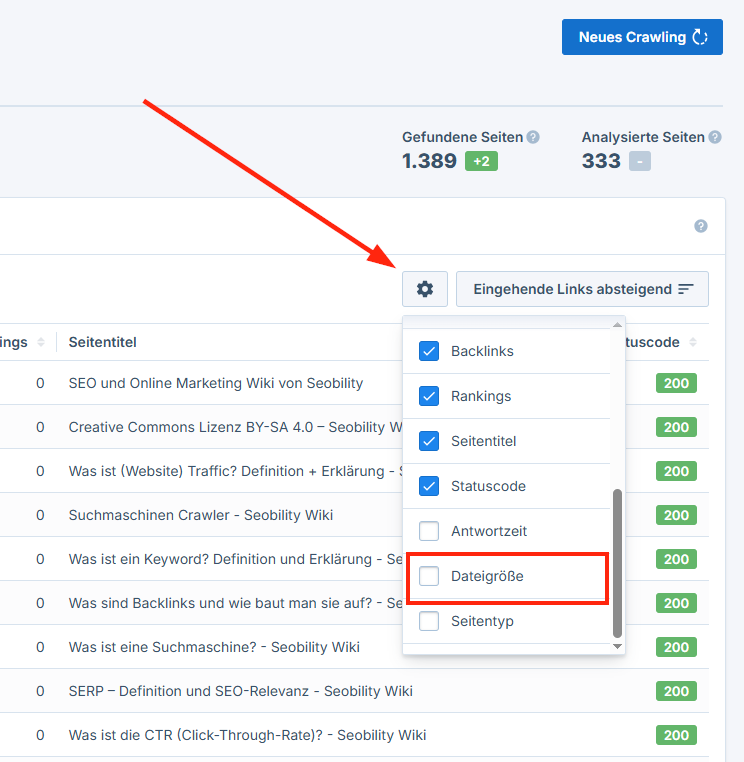

- Klicke auf das Zahnrad-Symbol auf der rechten Seite und anschließend auf “Dateigröße”, um diese Spalte einzublenden.

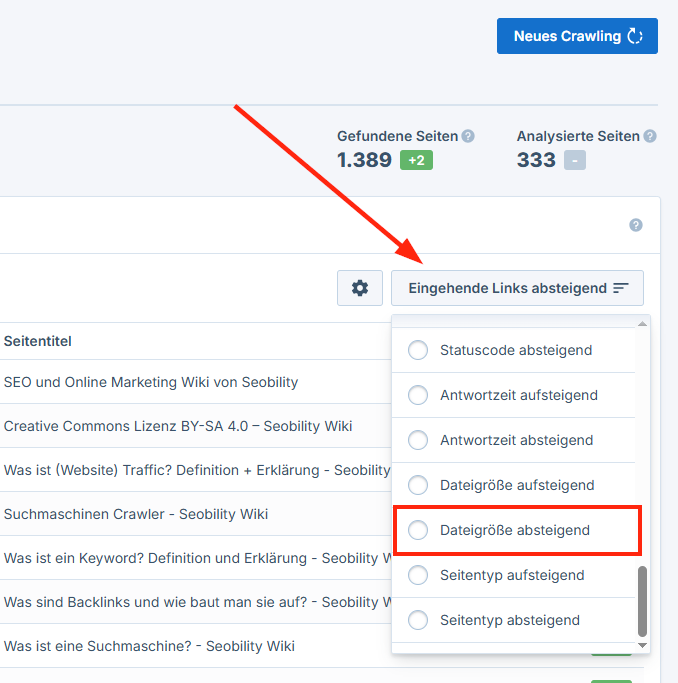

- Sortiere die Tabelle nach “Dateigröße absteigend”

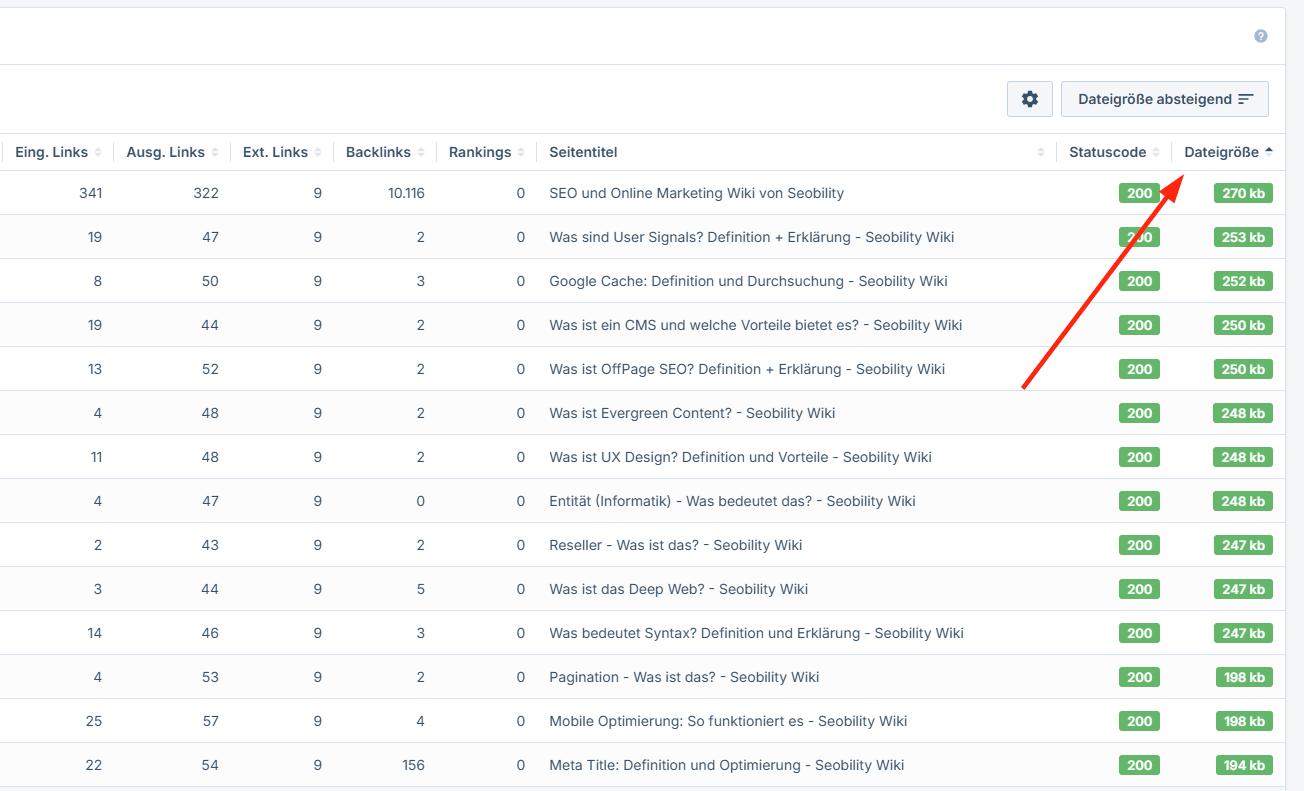

Anschließend kannst Du in der Spalte “Dateigröße” prüfen, wie groß die größten HTML-Seiten Deiner Website sind:

So bekommst Du schnell einen Überblick darüber, ob Handlungsbedarf besteht – und wenn ja, bei welchen URLs.

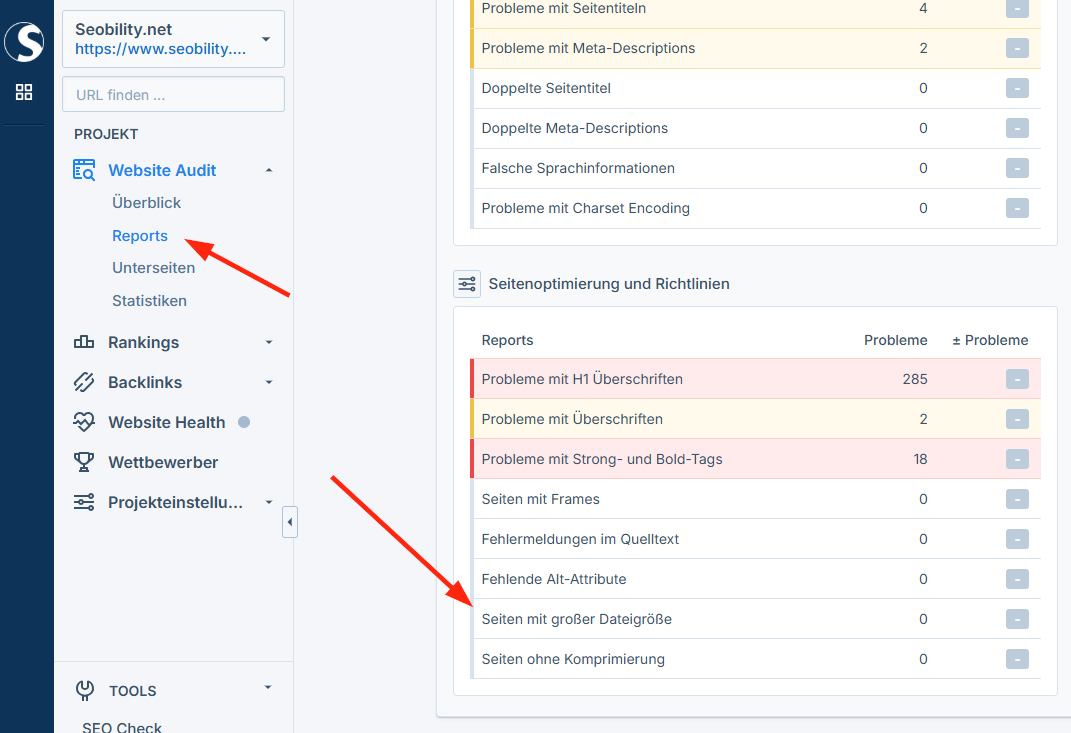

Seobility Report “Seiten mit großer Dateigröße”

In diesem Report zeigt Dir Seobility ebenfalls an, ob es auf Deiner Website sehr große HTML-Seiten gibt:

Seobility arbeitet hier bewusst mit einem Grenzwert von 0,5 MB (500 KB). Dieser Wert liegt deutlich unter dem aktuellen Google-Limit und dient als empfohlener Richtwert, um HTML-Dateien langfristig schlank und gut crawlbar zu halten.

Auch wenn eine Seite noch unter der 2-MB-Grenze von Google liegt, kann sie bereits in diesem Report auftauchen und als frühzeitiger Hinweis auf Optimierungspotenzial dienen.

Was kannst Du tun, wenn Seiten über 2 MB liegen?

Wenn einzelne Seiten auf Deiner Website größer als 2 MB sind, ist das kein Grund zur Panik. Oft sind es technische Details oder unnötiger Ballast, die sich relativ einfach beheben lassen.

HTML-Dateigröße reduzieren

Der erste Blick sollte immer auf den HTML-Code selbst gehen, denn hier steckt der eigentliche Seiteninhalt.

Ein häufiger Grund für große HTML-Dateien ist unnötiger oder aufgeblähter Code. Dazu gehören zum Beispiel Elemente, die zwar im Code vorhanden sind, auf der Seite jedoch keine sichtbare Funktion haben. Solcher Code kann oft entfernt werden, ohne dass sich das Erscheinungsbild der Seite ändert.

Auch Inline-Styles und Inline-JavaScript treiben die Dateigröße schnell in die Höhe. Dabei handelt es sich um CSS- oder JavaScript-Code, der direkt im HTML eingebettet ist. Besser ist es, diesen Code in externe Dateien auszulagern, die Google separat lädt.

Zusätzlich lohnt es sich, HTML-Kommentare, Leerzeichen (Whitespace) und unnötige Verschachtelungen im Code zu reduzieren. Moderne Tools oder Build-Prozesse können das oft automatisch übernehmen.

Wenn Du einen Page Builder wie Elementor, WPBakery oder ähnliche Systeme nutzt, solltest Du Dir bewusst sein: Diese Tools erzeugen oft sehr viel zusätzlichen Code. Gemeint ist damit der automatisch generierte HTML-Code, den der Page Builder im Hintergrund erstellt. Wenn möglich, solltest Du hier:

- unnötige Widgets oder Layout-Elemente entfernen

- sehr komplexe Layouts vereinfachen

- Inhalte, die nicht zwingend nötig sind, auslagern oder kürzen

CSS- und JavaScript-Dateien optimieren

CSS- und JavaScript-Dateien sollten “minifiziert” werden, um ihre Größe zu reduzieren.

Minifizieren bedeutet, dass aus diesen Dateien alles entfernt wird, was für den Browser nicht notwendig ist, zum Beispiel Kommentare oder überflüssige Leerzeichen. Das lässt sich meist sehr einfach umsetzen, etwa über:

- Performance-Plugins (z. B. bei WordPress)

- Hosting-Funktionen

- Content-Delivery-Netzwerke (CDNs)

Bei JavaScript kann es sinnvoll sein, große Dateien aufzuteilen. Statt ein riesiges Skript für die komplette Website zu laden, werden nur die Teile geladen, die auf der jeweiligen Seite wirklich gebraucht werden. Das wird auch als Code Splitting bezeichnet.

Außerdem solltest du alle Third-Party-Skripte kritisch prüfen, also externe Tools für Tracking, Analytics, Marketing oder Consent-Banner. Frage Dich bei jedem Skript: Brauche ich das wirklich auf jeder Seite?

Struktur & Content überdenken

Manchmal liegt das Problem weniger im Code als in der Art, wie eine Seite aufgebaut ist.

Sehr lange Seiten mit extrem vielen Inhalten können schnell sehr groß werden. In solchen Fällen kann es sinnvoll sein, den Content auf mehrere thematisch passende Unterseiten aufzuteilen.

Bei Infinite-Scroll-Seiten ist besondere Vorsicht geboten. Wenn immer mehr Inhalte direkt ins HTML geladen werden, wächst die Datei schnell über das Limit. Hier sollte Infinite Scroll sauber umgesetzt werden. Idealerweise in Kombination mit klassischer Pagination, sodass Google die Inhalte zuverlässig erfassen kann.

Unabhängig davon gilt: Wichtige Inhalte sollten möglichst weit oben im HTML stehen. So stellst Du sicher, dass Google sie auch dann noch sieht, wenn eine Seite das maximale Crawl-Limit erreicht.

Best Practices: So bleibst Du auf der sicheren Seite

Damit die neue Google-Grenze langfristig kein Problem für Deine Website wird, lohnt es sich, ein paar grundlegende Best Practices zu beachten. Sie helfen nicht nur beim Crawling, sondern verbessern oft auch Performance und Nutzererlebnis.

Sinnvolle Zielwerte für HTML-Dateien

Auch wenn Google ein Limit von 2 MB setzt, solltest Du deutlich darunter bleiben.

Als grober Richtwert gilt:

HTML-Dateien idealerweise unter 500 KB

Dieser Puffer sorgt dafür, dass neue Inhalte, zusätzliche Features oder Tracking-Skripte nicht sofort zum Problem werden. Außerdem sind kleinere HTML-Dateien in der Regel schneller geladen und leichter zu verarbeiten, was sich positiv auf Deinen Pagespeed auswirkt – ein wichtiger Google-Rankingfaktor.

Dateigrößen regelmäßig im Blick behalten

Große Dateien entstehen oft schleichend. Neue Plugins, zusätzliche Tracking-Tools oder kleine Design-Änderungen können den Code mit der Zeit immer weiter aufblasen.

Mit dem regelmäßigen Website Audit von Seobility kannst Du große Dateigrößen frühzeitig erkennen und entsprechende Maßnahmen zur Optimierung einleiten.

Performance und Crawlbarkeit als Teil von Content-Qualität verstehen

Content-Qualität besteht nicht nur aus guten Texten. Auch technische Sauberkeit spielt eine wichtige Rolle.

Eine Seite mit stark aufgeblähtem Code kann selbst dann an Sichtbarkeit verlieren, wenn der Inhalt eigentlich hochwertig ist.

Deshalb gilt: Performance und Crawlbarkeit sind kein reines Technikthema, sondern ein fester Bestandteil guter Inhalte.

Warum das auch für die KI-Suche wichtig ist

Nicht nur klassische Suchmaschinen profitieren von schlankem HTML. Auch KI-Systeme wie ChatGPT sind darauf angewiesen, Webinhalte klar und strukturiert zu erfassen.

Je sauberer und übersichtlicher Dein HTML aufgebaut ist, desto besser können Inhalte:

- korrekt interpretiert

- sinnvoll zusammengefasst

- und in KI-Antworten genutzt werden

Fazit: Technisches SEO wird immer wichtiger

Auch wenn nur ein kleiner Teil der Websites aktuell von der 2-MB-Grenze betroffen ist, zeigt die Änderung klar, in welche Richtung sich Google bewegt: Technisches SEO wird immer wichtiger.

Google legt immer mehr Wert auf effiziente, technisch saubere Websites, auf denen Inhalte leicht zugänglich und gut strukturiert sind.

Aufgeblähter Code, unnötige Skripte und überladene Seiten werden damit zunehmend zum Risiko – nicht nur für die klassische Google-Suche, sondern auch für KI-gestützte Systeme, die auf saubere HTML-Strukturen angewiesen sind.

Mit Seobility kannst Du genau das im Blick behalten – von der HTML-Dateigröße über technische Fehler bis hin zu konkreten Onpage-Optimierungspotenzialen. Hier kannst Du unsere Software 14 Tage kostenlos testen.

![Google reduziert Crawl-Limit auf 2 MB: Was das für Deine Website bedeutet [mit Daten aus Seobility]](https://www.seobility.net/wp-content/uploads/2026/02/google-crawlt-nur-noch-2mb-header.webp)