¿Qué es Noindex?

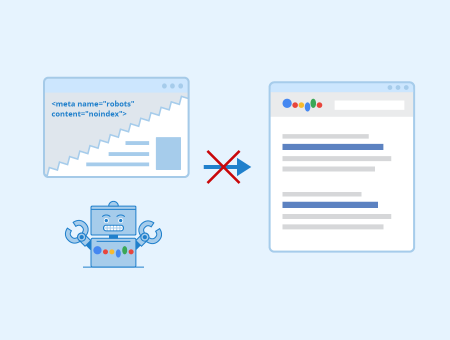

Noindex es un valor que se aplica en la metaetiqueta robots del código HTML de un sitio web. Se dirige a las arañas web de los buscadores como Google, Bing y Yahoo.

Si los bots encuentran este valor entre las meta tags de una página web, no la incluirán en su índice y, en consecuencia, no se mostrará al público en las SERPs.

Su opuesto es «index», que autoriza explícitamente indexar una página.

El comando noindex permite declarar si una determinada página web debe incluirse en el índice de los motores de búsqueda, pudiendo controlar la invisibilidad de cada subpágina individualmente. Es por ello que su aplicación se transforma en un componente destacado a la hora hacer SEO.

Google siempre utiliza por defecto una directiva noindex, mientras que considera la indexación solo como algo recomendado.

¿Para qué sirve esta directiva y cuándo tiene sentido usarla?

Con la ayuda de noindex, se pueden suprimir del índice de los buscadores las páginas que proporcionan poco o ningún valor añadido en caso de mostrarlas en los resultados de búsqueda.

Esto incluye, por ejemplo, los mapas de sitio o los resultados de una función de búsqueda interna. De ese modo, las subpáginas con datos sensibles o las áreas de descarga y de miembros protegidas por contraseña también pueden excluirse.

En el caso de aquellos sites con contenido duplicado, similar o paginado, la indexación tampoco es siempre recomendable desde un punto de vista SEO. Al excluir este contenido, Google no evalúa dichas páginas como contenido duplicado y, de esta forma, las subpáginas individuales no compiten entre sí con respecto al posicionamiento.

Esto podría ser útil, pongamos por caso, en las categorías de las tiendas online donde, al ordenar los productos según varios criterios, podrían llegar a solaparse. Por ejemplo, si las/los visitantes de un ecommerce filtran por talla, los artículos disponibles en varias tallas aparecerán en tantas pantallas como categorías de tallaje haya. Ahora bien, si se excluyen estas páginas de la indexación, el sitio web no sufre duplicidades, lo que es ideal para el SEO.

Con todo, hay que considerar que la relevancia de estas páginas (entre otros derivada de los backlinks) también podría perderse debido a la directiva noindex.

Así pues en estos casos lo mejor es utilizar una URL canónica para el contenido duplicado, ya que esta etiqueta mantiene el valor de los enlaces que dirigen a la página canónica y, al mismo tiempo, señalan a Google Bot cuál debe incluirse en su índice.

Otro caso de uso frecuente es en la paginación web que suele utilizarse para textos largos o galerías de imágenes. Aquí, podría tener sentido indexar únicamente la primera página para que las personas no acaben en medio del contenido de una serie de imágenes, sino al principio.

Sin embargo, su uso en este contexto no siempre tiene sentido. Los artículos editoriales especialmente largos no solo contienen información útil en esa primera página, también en las siguientes, por lo que podría provocar pérdidas de tráfico web, afectando negativamente al SEO. Para evitarlo, es mejor emplear la etiqueta rel=»next»/»prev» para la paginación.

¿Cómo implementar la etiqueta noindex en el código?

Para apartar una página web concreta del índice se añade “noindex” a la metaetiqueta robots en los metadatos, pues esta contiene instrucciones para los rastreadores de Google y de otros buscadores. Hay que integrarla en la cabecera (head) del código HTML:

<meta name="robots" content="noindex">

En lugar de rechazar a todos los rastreadores, también se puede dirigir a un motor en particular. Por ejemplo, si se quiere evitar que Google Bot indexe una subpágina, hay que sustituir el valor del atributo name por «googlebot» o, en el caso de Yahoo, por «slurp»:

<meta name="googlebot" content="noindex">

A pesar de ello, en la práctica SEO no tiene mucha lógica descartar solo a los bots individuales.

Como alternativa, se puede implementar este atributo a través de un campo en la cabecera de respuesta HTTP añadiendo el siguiente código:

X-Robots-Tag: noindex

Combinar noindex con follow o nofollow

De forma opcional, también se puede combinar la directiva noindex con los valores «follow» o «nofollow» para indicar a los robots de búsqueda cómo manejar los enlaces de la página no indexada, que seguirán dichos enlaces si han sido etiquetados como «follow».

La indexación de un mapa del sitio HTML rara vez tiene razón de ser, pero, desde el punto de vista del SEO, sí que es útil porque Google y otros motores acceden así a todas las subpáginas de un portal en pocos clics.

La directiva follow también es de utilidad para el SEO en lo que respecta a la paginación web o a las páginas de resultados de la función de búsqueda interna de las tiendas online. Muchas y muchos webmasters deciden no indexar dichas subpáginas debido a su escaso contenido informativo y a posibles problemas de duplicación. En este caso, «follow» es útil para garantizar que se puedan seguir encontrando e indexando los productos individuales ofrecidos en esas categorías.

También hay que tener en cuenta que Google deja de seguir los enlaces de una página noindex después de un cierto período de tiempo, siendo recomendable parcialmente para el SEO y en una estrategia a largo plazo.

A diferencia de follow, nofollow garantiza que los rastreadores no evalúen los enlaces de una subpágina.

Diferencia con «disallow» en un archivo robots.txt

Utilizando la directiva disallow en el archivo robots.txt, se puede precisar a los rastreadores que no operen en las áreas allí definidas.

Sería el caso de archivos como, por ejemplo, imágenes de grandes bases de datos, ahorrando tiempo de rastreo SEO. No se debería utilizar esta directiva si se desea que ciertos contenidos no sean indexados.

Aunque el comando prohíbe el rastreo de una página concreta, esta puede seguir apareciendo en el índice si los backlinks de otros sitios web apuntan a ella.

Por esta razón, nunca hay que combinar noindex y disallow en la misma página dado que los rastreadores siempre consultan el archivo robots.txt en primer lugar al indexar, luego observan la directiva disallow y, en consecuencia, se abstienen de rastrear las subpáginas correspondientes. De tal modo, no se percatan de las posibles directivas noindex y acaban incluyendo las subpáginas en el índice si están vinculadas a través de backlinks.

En conclusión, si no se desea que una determinada página se incluya en el índice de los buscadores, es tan sencillo como aplicar noindex.

Ampliar conocimientos

- Cómo eliminar o desindexar una URL en Google – Blog de rafalabrador.com

- https://developers.google.com/search/docs/advanced/crawling/block-indexing